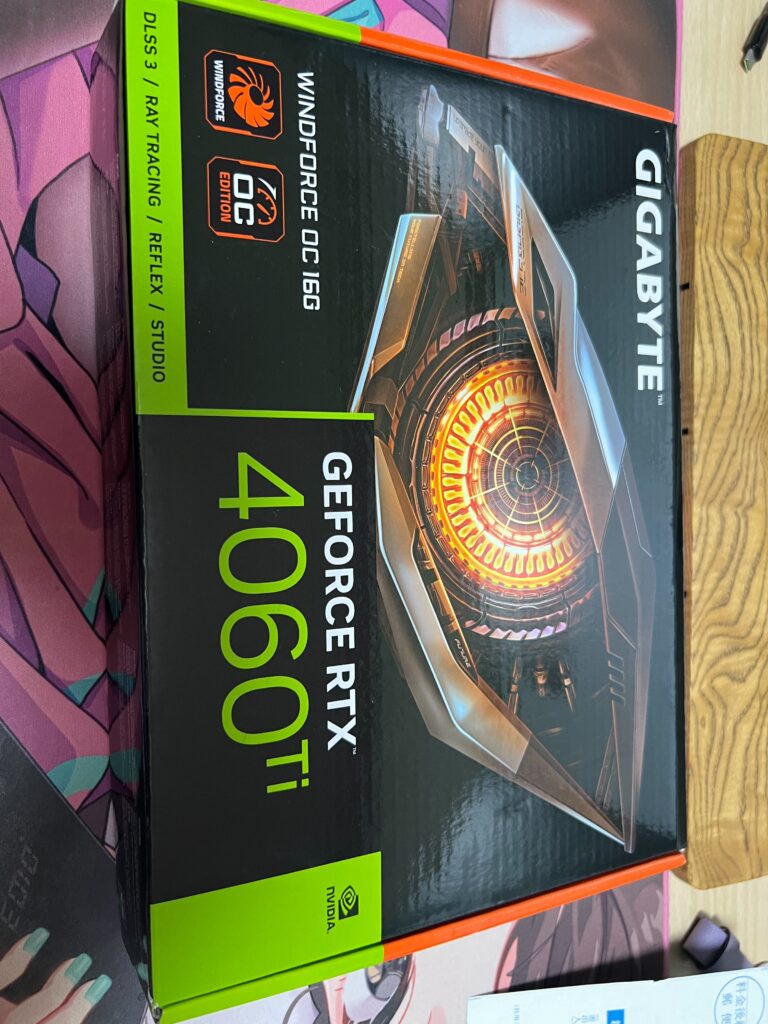

4060 ti 16GB 모델을 질렀다. 요즘 뭐 당연하겠지만, ai에 대해서는 일단 엔비디아 지포스 계열로 가는 게 맞다 싶을 정도로 쿠다랑 그 환경으로 되어있는 곳이 정말 잘 되어있는 것이 현실이다.

근데 왜 16GB냐면…. 솔직하게 말하자. VRAM이 깡패다. 회사에서도 ai 관련 일을 하면서 느낀 건데, 생각 이상으로 VRAM이 진짜 깡패다. ai 전용 gpgpu 같은 녀석들만 해도 메모리 장난 아니지만 그런 것들까지 아니라 해도 정말로 VRAM이 깡패다. LLM도 일반적인 사람들이 제대로 써보고 싶다고 하면 기본 48GB가 필요한 상황이다. stable diffusion은 말할 것도 없다. 8G는 그냥 돌아간다 수준이다. 4090 같은 건 코어 성능도 좋지만 VRAM도 기본 24GB다.

근데 그렇게까지 비싼 걸로는 사양 맞출 수는 없어서, 일단 16GB를 질렀다.

이런 내용은 원래 내 기술쪽 블로그에 적어야 하는데… 지른 이야기만 적어본다. ㅠㅠ